Rola predykcyjnych systemów w budowaniu odporności cyfrowej rodzi pytanie, czy zgodność z regulacjami jest wystarczająca?

Dyrektywa NIS 2 miała być, albo i może ma być przełomem w budowaniu odporności podmiotów kluczowych i ważnych w Europie – od energetyki i zdrowia po transport i finanse. I w zasadzie, to w teorii wyznacza jasne standardy jak np. raportowanie incydentów w 24 godziny, współdzielenie informacji z CSIRT, obowiązkowe plany BCP/DRP, odpowiedzialność zarządów.

Kluczowe pytanie brzmi czy zgodność oznacza bezpieczeństwo? Regulator ocenia procedury, ale przeciwnik testuje rzeczywistość.

W ujęciu prognostycznym jednak widać coś innego, bo w epoce sztucznej inteligencji to, co miało być tarczą, może stać się… mapą podatności. Każda procedura, każdy schemat, każdy ujawniony dokument to dziś paliwo treningowe dla modeli ofensywnych AI.

1. Zgodność jako iluzja bezpieczeństwa

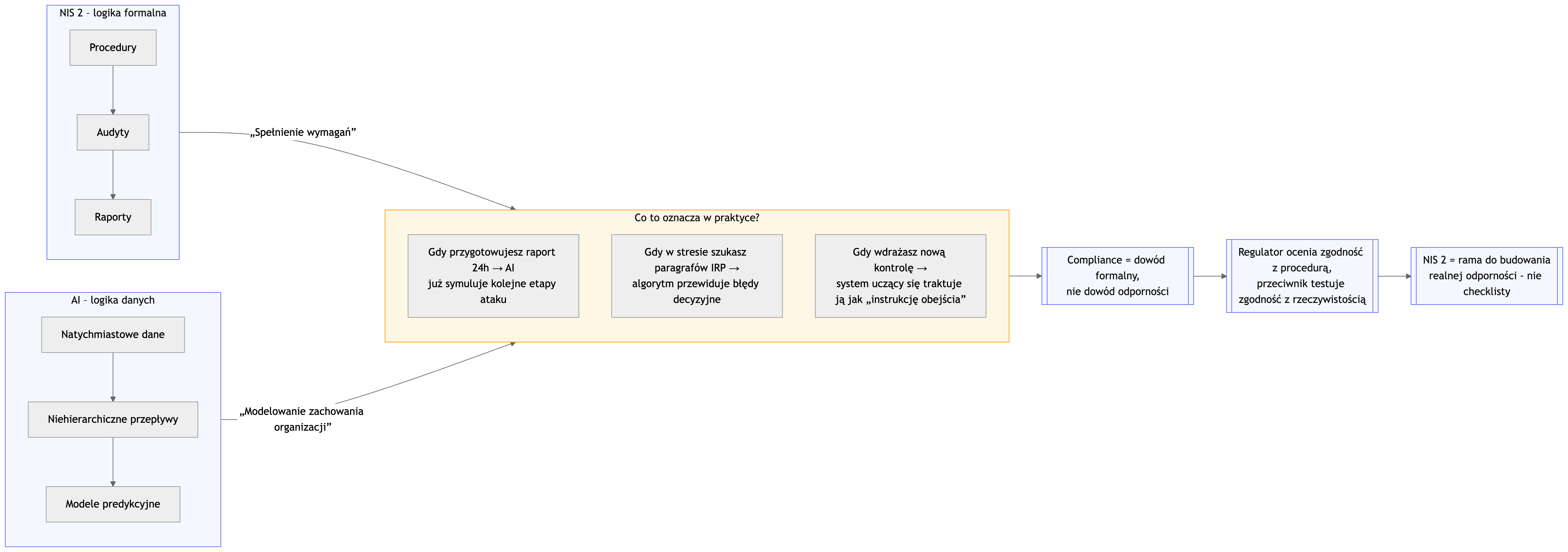

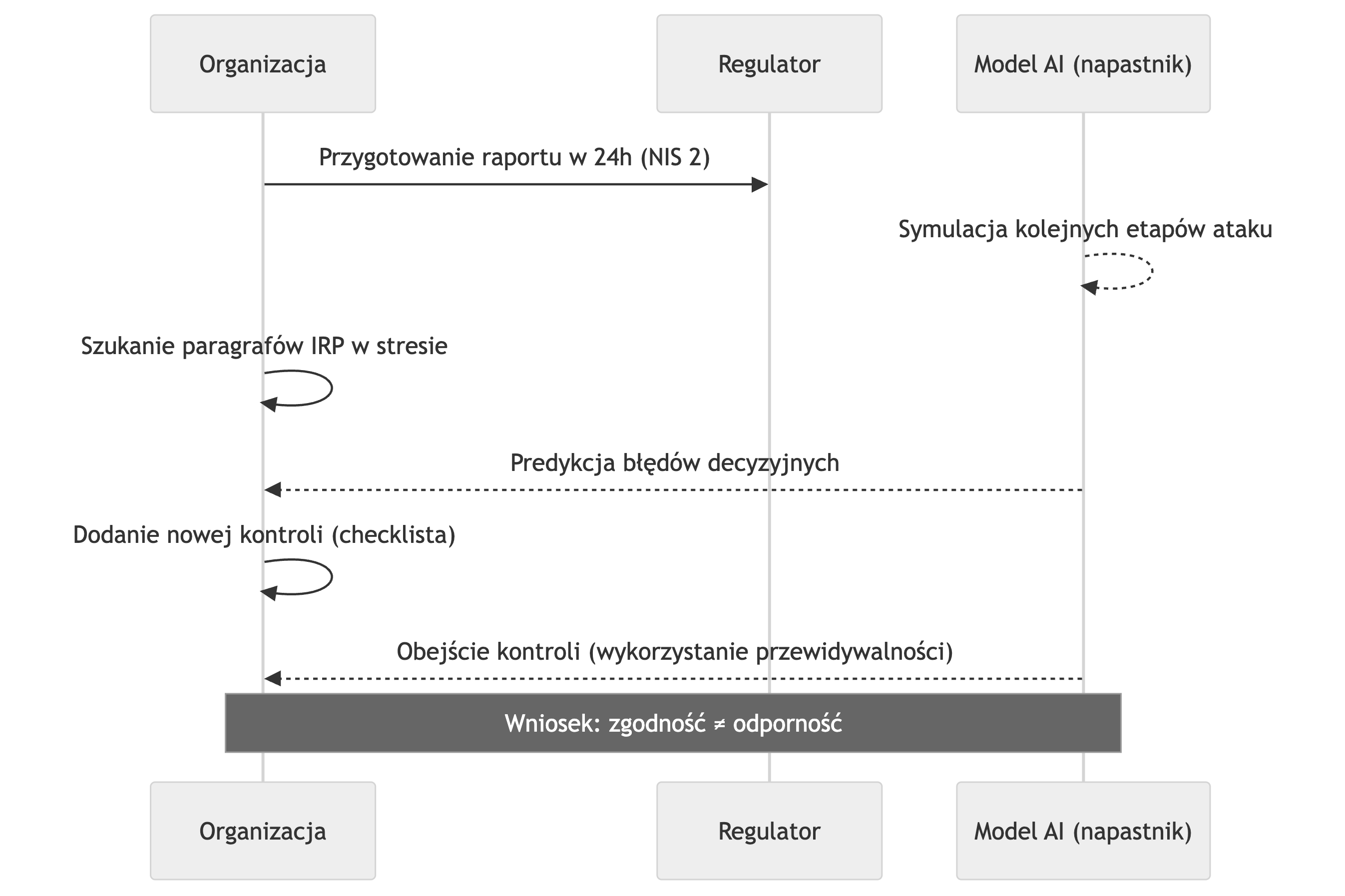

NIS 2 opiera się na logice formalnej takiej jak procedury, audyty, raporty a AI na logice danych, takich natychmiastowych, niehierarchicznych i predykcyjnych.

I w sumie co to oznacza w praktyce?

- Gdy organizacja szykuje się do raportowania w 24h, model AI już symuluje kolejne etapy ataku.

- Gdy ludzie w stresie szukają paragrafów w IRP (Incident Response Plan), algorytm przewiduje ich błędy decyzyjne.

- Gdy wdraża się kolejną warstwę kontroli, system uczący się traktuje ją jak instrukcję obejścia.

To nie oznacza, że NIS 2 jest bezużyteczna. Oznacza, że jej literalne wdrożenie nie wystarczy – trzeba ją traktować jako ramę do budowania realnej odporności, a nie checklistę.

|

Compliance to dowód formalny, a nie dowód odporności. Regulator ocenia zgodność z procedurą, przeciwnik testuje zgodność z rzeczywistością. |

2. Dokumentacja jako broń obosieczna

Plany ciągłości działania (BCP), plany reagowania na incydenty (IRP), polityki bezpieczeństwa z punktu widzenia regulatora to dowód rzetelności, a punktu widzenia AI to gotowa mapa:

- hierarchii decyzyjnej,

- momentów inercji (gdzie potrzebna jest zgoda, podpis, audyt),

- przewidywalnych ścieżek reakcji.

Im bardziej przejrzysty system, tym łatwiej go zrekonstruować.

To bez wątpienia paradoks NIS 2 – im bardziej organizacja spełnia wymagania jawności i formalizacji, tym łatwiej jest modelowana.

|

Paradoks NIS 2 nie polega na tym, że procedury są publiczne — bo ani dyrektywa tego nie wymaga, ani też tak się nie robi. Problemem jest to, że sama formalizacja i ujednolicenie procesów czyni organizację bardziej przewidywalną. |

W rękach audytora dokumentacja potwierdza dojrzałość organizacji, ale w rękach algorytmu staje się punktem wyjścia do symulacji ataku. Każdy zapis w BCP czy IRP to dla AI nie tylko procedura obronna, ale także przewidywalny wzorzec zachowania zespołu. Jeśli wiadomo, kto podejmuje decyzję i w jakim czasie, można ten proces zablokować, spowolnić albo zmanipulować. W efekcie organizacja, która jest najbardziej transparentna i zgodna z wymogami, staje się równocześnie najbardziej przewidywalna i podatna.

Możliwy jest incydent, w którym celem ataku nie stają się systemy IT, lecz sam proces decyzyjny. Wykorzystanie wiedzy o tym, że procedura reakcji wymaga sekwencji zgód — najpierw kierownika działu, następnie prawnika, a na końcu członka zarządu — pozwala przeciwnikowi generować serię pozornie poważnych alertów. Każdy z nich inicjuje konieczność formalnego potwierdzenia i w rezultacie blokuje działania operacyjne. Prawdziwy incydent, pojawiający się równolegle, zostaje uwięziony w biurokratycznej kolejce. Zespół techniczny widzi problem, ale bez zgód nie podejmuje działań, a czas działa na korzyść napastnika. W efekcie formalna zgodność zostaje zachowana, natomiast odporność operacyjna zostaje osłabiona.

3. Nowe wektory ataku, o których NIS 2 nie mówi

NIS 2 koncentruje się na zabezpieczeniach technicznych i proceduralnych, ale praktyka pokazuje, że najgroźniejsze scenariusze nie mieszczą się w klasycznych kategoriach exploitów czy malware. Pojawiają się wektory ataku, które uderzają w procesy decyzyjne, w zdolność organizacji do rozpoznania sytuacji i w jej odporność operacyjną.

Zgodność nie chroni przed scenariuszami, które dziś stają się coraz bardziej realne:

- Sabotaż poznawczy – generowanie fałszywych alertów XDR/XSIAM mających na celu znieczulenie zespołów SOC i odwrócenie ich uwagi od prawdziwych incydentów.

- Symulowana dezintegracja – subtelne zakłócenia danych telemetrycznych (np. w SCADA/OT), które prowadzą operatorów do błędnych decyzji, mimo że systemy technicznie działają.

- Atak na graf decyzyjny – nie przejmowanie serwera, lecz blokada lub przejęcie kluczowych kanałów informacyjnych i ról decyzyjnych, co wywołuje efekt domina w łańcuchu reakcji.

- Dezinformacja operacyjna – skoordynowane komunikaty (wewnętrzne i zewnętrzne) zmuszające zespoły do działania poza procedurami, co prowadzi do „legalnych” błędów operacyjnych.

|

Największym ryzykiem dla zarządu nie jest luka w systemie, lecz luka w procesie decyzyjnym. NIS 2 rozlicza nie tylko IT, ale i błędy organizacyjne. |

Elementy tych scenariuszy widzimy już dziś – od kampanii fałszywych alertów SOC, po zakłócenia w systemach SCADA, które prowadziły operatorów do błędnych decyzji.

Żaden z tych scenariuszy nie wymaga klasycznego exploita. Wystarczy znajomość procedur i umiejętność ich predykcyjnego wykorzystania — a więc dokładnie to, co NIS 2 ma uregulować: procesy, role i obowiązki. Dlatego projektowanie odporności w epoce AI musi obejmować nie tylko technologie, lecz także strukturę decyzji i komunikacji.

Ataki mogą uderzać w procesy decyzyjne i komunikację, wywołując chaos operacyjny. Skutkiem są błędne decyzje, niewłaściwe raportowanie i odpowiedzialność zarządu wynikająca z NIS 2. Kluczowe jest wprowadzanie zastępowalności ról oraz testowanie procedur w warunkach presji informacyjnej.

4. Jak wdrażać NIS 2 inaczej

Traktowanie dyrektywy wyłącznie jako "kolejnej normy" jest ryzykowne. W epoce AI potrzebne jest podejście, które wykracza poza checklisty i audyty. Kluczowe obszary to:

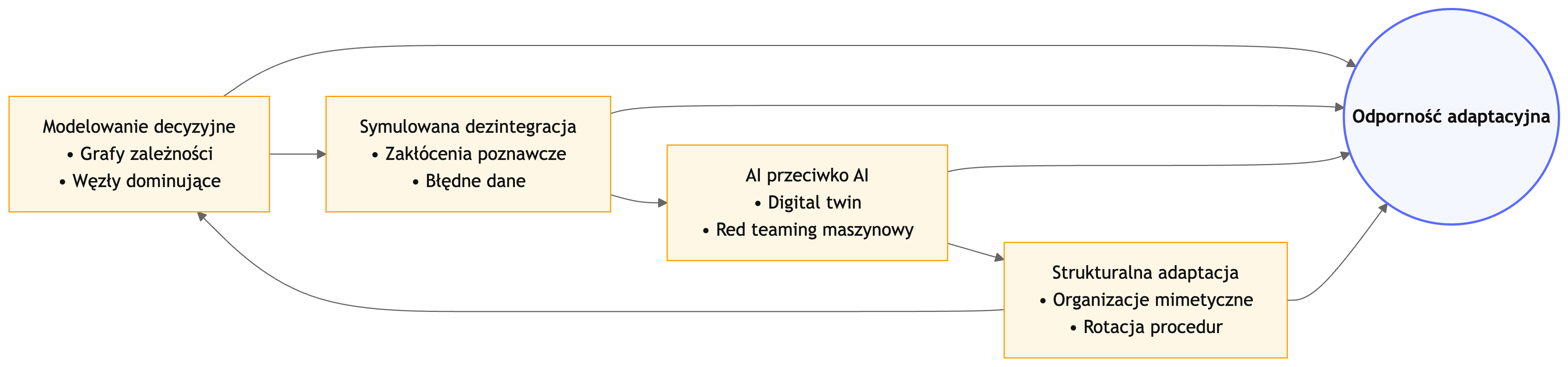

Modelowanie decyzyjne organizacji

Mapowanie rzeczywistych przepływów informacji i zależności. Identyfikacja węzłów dominujących i scenariuszy efektu domina, które mogą sparaliżować działanie całej struktury.

Symulowana dezintegracja

Testowanie odporności nie tylko poprzez klasyczne pentesty, ale także przez symulowane zakłócenia poznawcze i strukturalne. Sprawdzanie, jak organizacja radzi sobie z błędnymi danymi czy opóźnieniami decyzyjnymi.

AI przeciwko AI

Budowa własnych modeli predykcyjnych i digital twin organizacji, które pozwalają prowadzić „red teaming maszynowy”. Dzięki temu scenariusze destabilizacji można przetestować zanim zrobi to przeciwnik.

Strukturalna adaptacja

Tworzenie organizacji „mimetycznych” – zmieniających rytm, priorytety i przepływy informacji. Regularna rotacja procedur i zespołów, aby uniknąć przewidywalności, którą AI może łatwo wykorzystać.

Rys. 3. Cztery filary adaptacyjnej zgodności z NIS 2

Każdy z filarów opisuje inny aspekt budowania odporności: od modelowania organizacji, przez symulacje zakłóceń, po adaptację struktur.

Legenda: Modelowanie decyzyjne — grafy przepływów, węzły dominujące; Symulowana dezintegracja — zakłócenia poznawcze/strukturalne; AI przeciwko AI — digital twin, red teaming; Strukturalna adaptacja — rotacja procedur, organizacje mimetyczne.

Co ważne, to te filary nie zastępują wymagań NIS 2, lecz czynią je odpornymi na przewidywalność ofensywnego AI.

5. NIS 2 jako szansa, a nie obowiązek

Największym błędem będzie potraktowanie NIS 2 jak kolejnego ISO do „odhaczenia”. To nie jest lista kontrolna, lecz pretekst do zmiany paradygmatu:

- od reakcji do predykcji,

- od audytów do symulacji,

- od statycznych dokumentów do dynamicznych modeli.

NIS 2 to obowiązek prawny, ale też wyjątkowa okazja, by przekształcić bezpieczeństwo w źródło przewagi. Organizacje, które zrozumieją ją jako ramę dla eksperymentowania z AI, modelowaniem i odpornością adaptacyjną, nie tylko spełnią wymagania regulatora — one wyznaczą standard w swojej branży.

Odporność nie polega na liczbie wdrożonych systemów, ale na zdolności przewidywania własnych trajektorii porażki — zanim zrobi to algorytm przeciwnika.

W tym sensie NIS 2 nie ogranicza, lecz otwiera pole do transformacji. W epoce sztucznej inteligencji wygra ten, kto pierwszy zacznie symulować i testować samego siebie — bo przewaga predykcyjna nie daje się nadrobić.

|

NIS 2 to nie kolejny obowiązek do odhaczenia. To okazja, by uczynić bezpieczeństwo przewagą konkurencyjną. Compliance chroni przed sankcją, odporność przed katastrofą. A w epoce AI wygrają ci, którzy pierwsi nauczą się przewidywać własne słabości — zanim zrobi to przeciwnik. |

Kto zrozumie tę różnicę, potraktuje NIS 2 nie jako ciężar regulacyjny, lecz jako przewagę strategiczną.

To nie kwestia nowej technologii, ale nowego sposobu myślenia. Systemów nie chroni się już silniejszymi zaporami, lecz głębszym zrozumieniem, jak i dlaczego mogą się rozpaść. Przyszłość planowania operacyjnego nie będzie należała do tych, którzy zgromadzą więcej danych, lecz do tych, którzy potrafią szybciej zbudować modele własnej porażki, niż przeciwnik zdąży stworzyć model ataku.

"Zgodność to tarcza przed audytorem, nie przed napastnikiem. Odporność buduje się nie w dokumentach, ale w zdolności przewidywania i adaptacji."

własny

Uwaga

Zamieszona treść ma wyłącznie charakter informacyjno-edukacyjny i nie może być wykorzystana w jakikolwiek sposób niezgodny z prawem. Przed zastosowaniem się m.in. do wskazówek i porad zawartych w artykule należy bezwzględnie skonsultować się z ekspertem i/lub skorzystać z usług prawnika. Informacje zawarte w niniejszym artykule zostały zebrane i przedstawione w dobrej wierze i na podstawie źródeł uznanych za wiarygodne, jednak autor nie ponosi odpowiedzialności za kompletność, aktualność oraz rzetelność zamieszczonych informacji, które mogą być przedstawione w formie niepełnej, skróconej lub mogą być przedawnione. Autor artykułu nie ponosi żadnych konsekwencji wynikających z wykorzystania informacji zawartych w niniejszym poście.

Źródło:

- Dyrektywa Parlamentu Europejskiego i Rady (UE) 2022/2555 z dnia 14 grudnia 2022 r. w sprawie środków na rzecz wysokiego wspólnego poziomu cyberbezpieczeństwa na terytorium Unii (dyrektywa NIS 2). Dz. Urz. UE L 333 z 27.12.2022.

- Dyrektywa Parlamentu Europejskiego i Rady (UE) 2016/1148 z dnia 6 lipca 2016 r. w sprawie środków na rzecz wysokiego wspólnego poziomu bezpieczeństwa sieci i systemów informatycznych na terytorium Unii.

- Rozporządzenie Parlamentu Europejskiego i Rady (UE) 2019/881 z dnia 17 kwietnia 2019 r. w sprawie ENISA (Agencji Unii Europejskiej ds. Cyberbezpieczeństwa) oraz certyfikacji cyberbezpieczeństwa w zakresie technologii informacyjno-komunikacyjnych oraz uchylenia rozporządzenia (UE) nr 526/2013 (akt o cyberbezpieczeństwie).

- Rozporządzenie Parlamentu Europejskiego i Rady (UE) nr 910/2014 z dnia 23 lipca 2014 r. w sprawie identyfikacji elektronicznej i usług zaufania w odniesieniu do transakcji elektronicznych na rynku wewnętrznym oraz uchylające dyrektywę 1999/93/WE.

- ENISA. ENISA Threat Landscape 2023. European Union Agency for Cybersecurity, 2023.

- NIST. Cybersecurity Framework (CSF) 2.0. National Institute of Standards and Technology, 2024.

- ISO/IEC 27001:2022 – Information security, cybersecurity and privacy protection — Information security management systems — Requirements. International Organization for Standardization, Geneva, 2022.

(przyjęta w Europie jako EN ISO/IEC 27001:2023) - ISO/IEC 27002:2022 – Information security, cybersecurity and privacy protection — Information security controls. International Organization for Standardization, Geneva, 2022.

- ISO/IEC 27005:2022 – Information security, cybersecurity and privacy protection — Guidance on information security risk management. International Organization for Standardization, Geneva, 2022.

Przeczytaj również: Symulowana Dezintegracja poprzez Badania Operacyjne i Teorię Systemów Decyzyjnych jako Narzędzia Predykcyjnej Ochrony Infrastruktury Krytycznej, Między Kodem a Katastrofą - Nowe Paradygmaty Ataku na Infrastrukturę Krytyczną, Rodzaje zagrożeń dla Infrastruktury Krytycznej w erze cyfryzacji i AI, Pojęcie infrastruktury krytycznej, Infrastruktura krytyczna w teorii, Infrastruktura krytyczna w ujęciu prawnym, Właściwości systemu infrastruktury krytycznej, Architektura systemu infrastruktury krytycznej, Bezpieczeństwo energetyki jądrowej w Polsce, Cyberterroryzm jako element zagrożenia, Terroryzm a infrastruktura krytyczna, Uzależnienie od obcej technologii, Ochrona infrastruktury krytycznej, Środki ochrony infrastruktury krytycznej, Zabezpieczenia infrastruktury krytycznej, Rozpoznanie i wyznaczenie infrastruktury krytycznej, Zarządzanie infrastrukturą krytyczną, Zarządzanie ryzykiem w infrastrukturze krytycznej, Planowanie zarządzania ryzykiem, Identyfikacja ryzyka, Jakościowa i ilościowa analiza ryzyka, Planowanie reakcji na ryzyko, Monitorowanie ryzyka, Literatura dot. infrastruktury krytycznej, Akty prawne dot. infrastruktury krytycznej

Publikacja jest dostępna na licencji Creative Commons Uznanie autorstwa 4.0 Międzynarodowe, pewne prawa zastrzeżone na rzecz autora i machnacz.eu. Zezwala się na dowolne wykorzystywanie treści publikacji pod warunkiem wskazania autora (Andrzej Machnacz, machnacz.eu) i podania informacji o licencji.